L’intelligence artificielle est devenue partie intégrante de notre vie quotidienne, et parmi ses diverses applications, l’une d’entre elles est devenue un phénomène troublant et grandissant : le Deepfake. Ces vidéos et ces enregistrements audio altérés sont générés grâce à l’IA et peuvent créer des contenus fallacieux plus vrais que nature. Cet article vise à détailler ce phénomène et à mettre en lumière les menaces qu’il représente.

Qu’est-ce qu’un deepfake?

Deepfake est un terme provenant de la fusion des mots “Deep Learning” et “Fake”, ce qui peut être traduit par “Fausse Profondeur”. Il s’agit de contenus modifiés ou fabriqués de manière si réaliste que même les humains peuvent être trompés. Le terme est étroitement lié à un utilisateur Reddit qui a utilisé le Deep Learning pour intégrer les visages de célébrités dans des films pour adultes, ce qui a conduit à une popularité massive de ce phénomène.

Comment sont créés les Deepfakes?

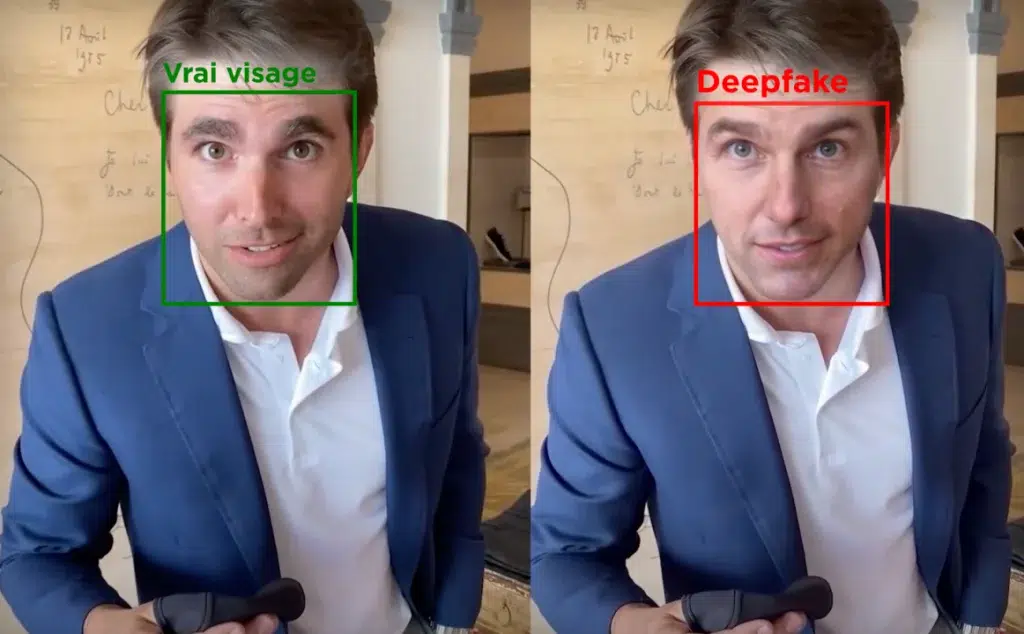

Les deepfakes sont générés à l’aide de la technique des GANs (Generative Adversarial Networks), qui est une technique de Machine Learning où deux algorithmes sont mis en compétition. Le premier algorithme, appelé “générateur”, vise à créer des fausses imitations, mais crédibles, tandis que le second, appelé “discriminateur”, cherche à repérer ces faux.

Au fil du temps, les deux algorithmes s’améliorent : le générateur crée des fausses vidéos de plus en plus réalistes, jusqu’à ce que le discriminateur ne puisse plus distinguer le vrai du faux. Plus il y a de données fournies à l’algorithme au début, plus il est capable d’apprendre à créer de faux contenus de manière convaincante. C’est pourquoi les personnalités publiques, les anciens présidents américains et les stars d’Hollywood sont souvent utilisés pour créer des deepfakes, car il existe une abondance de vidéos d’archives qui peuvent être utilisées pour entraîner les modèles de Machine Learning.

Quels sont les dangers des Deepfakes?

Avec l’accessibilité de logiciels comme FakeApp, n’importe qui, sans compétences techniques particulières, peut créer un deepfake. Cette possibilité ouvre la voie à l’utilisation de cette technologie pour manipuler l’opinion publique, répandre de fausses informations, humilier ou diffamer des individus, et même pour la propagande ou le terrorisme.

Pour illustrer ce point, imaginons une fausse vidéo d’alerte à la bombe ou une sex-tape truquée visant à ruiner un mariage ou une réputation. En outre, si les contenus deepfake prolifèrent sur le web, les internautes pourraient perdre toute confiance dans les vidéos, ce qui constitue un autre risque important.

Exemples connus de Deepfakes

Le phénomène des Deepfakes a débuté en 2017 lorsqu’un utilisateur Reddit a commencé à intégrer des visages de célébrités dans des films pour adultes. De plus, la chaîne YouTube derpfakes modifie les bandes-annonces de films grâce à l’IA. Par exemple, ils ont modifié la bande-annonce du film Star Wars Solo pour remplacer l’acteur principal par Harrison Ford.

Un autre exemple frappant est le site web “ThisPersonDoesNotExist.com”, qui génère un faux visage toutes les deux secondes grâce à l’IA. NVIDIA a également créé une IA capable de générer de faux visages. Plus récemment, une vidéo deepfake montrant Mark Zuckerberg, le créateur de Facebook, a été diffusée sur Instagram, où il prétendait révéler “toute la vérité” sur son réseau social et son intention de contrôler l’humanité.

Comment détecter un Deepfake?

La détection des Deepfakes devient une nécessité face à leur prolifération. Voici quelques indicateurs pour vous aider à les repérer :

- Les visages dans les deepfakes peuvent être animés de manière non naturelle. Par exemple, le sujet ne cligne peut-être jamais des yeux, ou cligne des yeux de manière anormale.

- Il peut y avoir des anomalies dans la peau ou les cheveux du sujet, ou leur visage peut sembler plus flou que l’environnement dans lequel ils se trouvent.

- L’éclairage dans les deepfakes peut ne pas paraître naturel. Les algorithmes de deepfake conservent souvent l’éclairage des clips utilisés comme modèles, ce qui peut ne pas correspondre à l’éclairage de la vidéo cible.

- L’audio de la vidéo peut ne pas correspondre à la personne dans la vidéo, surtout si l’audio original n’a pas été manipulé avec soin.

L’avenir des Deepfakes reste incertain. Alors que cette technologie a le potentiel de créer des effets spéciaux impressionnants et de l’art, elle présente également des risques majeurs. En comprenant ce phénomène et en restant vigilants, nous pouvons minimiser les dommages potentiels et profiter des avantages que l’IA peut offrir.

Quels sont les moyens de lutte contre les Deepfakes ?

Face à la menace des deepfakes, de nombreuses initiatives ont vu le jour pour contrer leur propagation. Voici quelques-unes des solutions actuellement utilisées et développées :

- Développement de l’IA pour détecter les deepfakes : Comme les deepfakes sont créés par l’IA, l’IA peut aussi être utilisée pour les détecter. De nombreuses entreprises et institutions de recherche travaillent sur des solutions qui pourraient automatiquement identifier les deepfakes. Par exemple, Facebook a lancé le “Deepfake Detection Challenge” en 2019, avec pour objectif d’accélérer le développement de nouvelles technologies de détection des deepfakes.

- Législation : De plus en plus de pays adoptent des lois pour lutter contre les deepfakes. Par exemple, en Californie, il est maintenant illégal de créer et de diffuser des deepfakes visant à dénigrer un candidat politique ou à influencer l’issue d’une élection.

- Formation et éducation : Éduquer le public sur le phénomène des deepfakes est crucial. En comprenant comment les deepfakes sont créés et comment les repérer, les gens seront mieux équipés pour les dénoncer et ne pas se laisser tromper.

- Authentification des médias : Des technologies sont développées pour authentifier les contenus numériques et pour suivre leur provenance et leur chaîne de modifications. Cela permettrait aux utilisateurs de vérifier l’authenticité d’une vidéo avant de la partager.

Perspectives

Malgré les menaces, il convient de noter que les deepfakes ont également des applications positives. Par exemple, ils peuvent être utilisés dans l’industrie du cinéma pour des effets spéciaux ou pour faire “revenir” des acteurs décédés. Ils pourraient également permettre la création de doublures numériques pour les jeux vidéo ou les expériences de réalité virtuelle.

Cependant, l’importance de créer des mécanismes pour contrôler l’utilisation des deepfakes est évidente. Leur utilisation malveillante pourrait avoir des conséquences dramatiques sur l’individu et la société, en particulier dans un monde de plus en plus dépendant de l’information digitale.

À mesure que nous avançons dans le futur, il sera essentiel de développer des stratégies robustes pour lutter contre les deepfakes tout en tirer profit de leurs utilisations positives. L’éducation, la législation et la technologie joueront toutes un rôle crucial dans cet effort.